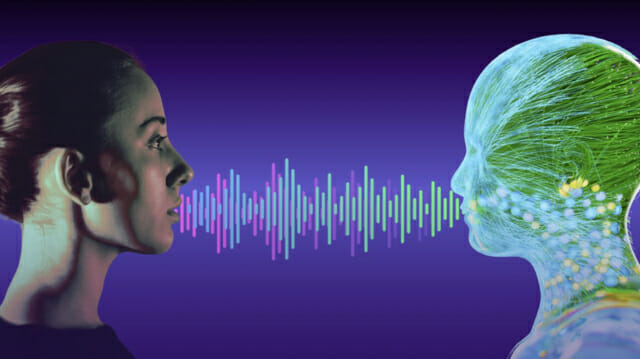

AI 음성 복제 기술, 축복일까 재앙일까? 사기 및 개인정보 도용 위험성 증가에 대한 우려

AI 음성 복제 기술의 급속한 발전: 새로운 가능성과 심각한 위험성

최근 AI 기술의 눈부신 발전으로 누구나 간단한 오디오 샘플만으로 특정 인물의 목소리를 완벽하게 재현할 수 있는 시대가 도래했습니다. 몇 초 분량의 음성 데이터만 있으면 인공지능이 이를 학습하여 자연스럽게 대화를 생성하는 것이 가능하며, 비용 또한 저렴해져 기술 접근성이 크게 향상되었습니다. 이러한 AI 음성 복제 기술은 엔터테인먼트, 교육 등 다양한 분야에서 혁신적인 활용 가능성을 제시하지만, 동시에 심각한 윤리적, 사회적 문제를 야기할 수 있다는 우려가 커지고 있습니다.

사기 범죄 및 개인정보 도용의 위험성 증대

AI 음성 복제 기술의 악용 사례가 속속 등장하며 사회적 불안감이 고조되고 있습니다. 사기범들은 유명인의 목소리를 흉내내 금융 사기를 시도하거나, 가족이나 지인의 목소리를 모방하여 금전을 갈취하는 범죄를 저지를 수 있습니다. 또한, 개인정보 도용의 위험성 또한 간과할 수 없습니다. AI 음성 복제 기술을 이용하여 개인의 동의 없이 음성을 도용하여 허위 정보를 유포하거나 명예를 훼손하는 행위가 발생할 수 있습니다. 컨슈머 리포트(Consumer Reports)의 조사 결과, AI 음성 복제 기술을 이용한 사기 시도가 급증하고 있으며, 피해 규모 또한 상당한 수준에 달하는 것으로 나타났습니다.

법적 규제 및 기술적 대응 방안 마련 시급

AI 음성 복제 기술의 악용을 막기 위해서는 법적 규제 마련이 시급합니다. 음성 데이터의 무단 사용 및 도용에 대한 처벌 강화는 물론, AI 음성 복제 기술을 이용한 범죄에 대한 처벌 수위를 높여야 합니다. 또한, 기술적인 대응 방안 마련도 중요합니다. AI 음성 복제 기술을 탐지하고 차단하는 기술 개발, 음성 데이터의 위변조 여부를 판별하는 기술 개발 등이 필요합니다. 개인 차원에서도 AI 음성 복제 기술의 위험성을 인지하고, 의심스러운 전화나 메시지에 현혹되지 않도록 주의해야 합니다.

AI 윤리 의식 함양 및 사회적 합의 도출 노력 필요

AI 음성 복제 기술의 윤리적 문제는 기술 개발 단계부터 고려되어야 합니다. AI 개발자들은 기술의 잠재적 위험성을 인지하고, 악용될 가능성을 최소화하기 위한 노력을 기울여야 합니다. 또한, AI 윤리에 대한 사회적 논의를 활성화하고, AI 기술의 책임 있는 사용에 대한 사회적 합의를 도출해야 합니다. AI 음성 복제 기술은 우리 사회에 큰 변화를 가져올 수 있는 기술입니다. 긍정적인 측면을 최대한 활용하고, 부정적인 측면을 최소화하기 위한 노력이 필요합니다.